Analysetools Energieoptimierung

Loxone Statistikaufzeichnung

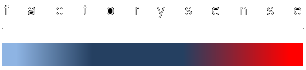

Die Basis für eine fundierte Analyse ist die Aufzeichnung von Statistikdaten über die Loxone Automatisierung. Diese bietet reichlich Möglichkeiten Daten zu sammeln. Ein simples Häkchen gesetzt an diversen Bausteinen, Eingängen oder Ausgängen und schon werden die Daten in einstellbaren Intervallen aufgezeichnet.

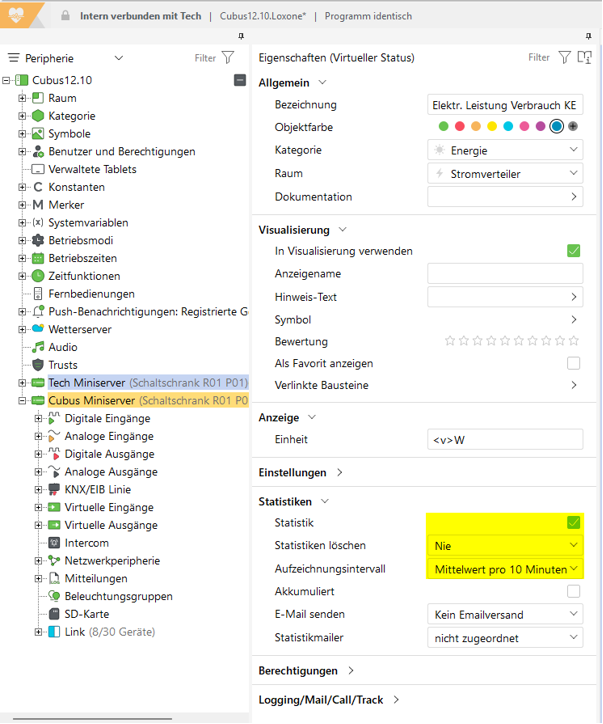

Einziger Wermutstropfen bei der Statistikaufzeichnung mit Loxone, ist die Beeinträchtigung der SD-Karte durch erhöhte Schreiblast. Obwohl in meiner Heimautomatisierung keine ereignisbasierten Aufzeichnungen stattfinden, summieren sich die Datenmengen allein durch die Vielzahl der aufgezeichneten Datenpunkte und auf diese möchte ich auch nicht verzichten.

Unglücklicherweise kann diese Schreiblast zur Verkürzung der Lebensdauer der SD-Karte beitragen. Da dort auch das Programm der Loxone Config beheimatet ist, kann das durchaus zu Problemen führen. Eine formattierte Backup-Karte ist deshalb empfehlenswert.

Als Wunsch an das Loxone-Christkind adressiere ich den Vorschlag, eine dezidierte Karte für Statistikaufzeichung einzuführen. Für den aktuellen Miniserver wird sich das wohl nicht mehr ausgehen, für zukünftige Miniserver Versionen wäre das aber sicherlich eine sinnvolle Erweiterung, die mir auch den ein oder anderen Euro an Zusatzkosten wert wäre.

Extract, Transform, Load

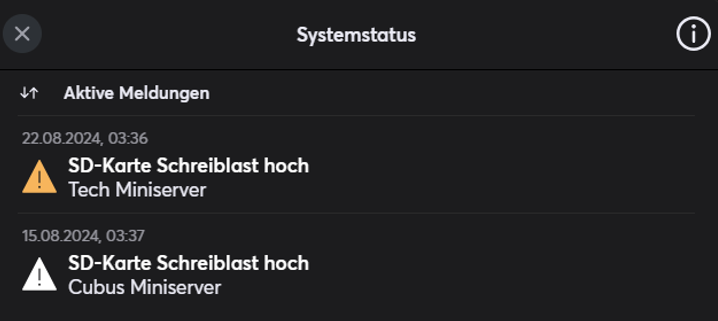

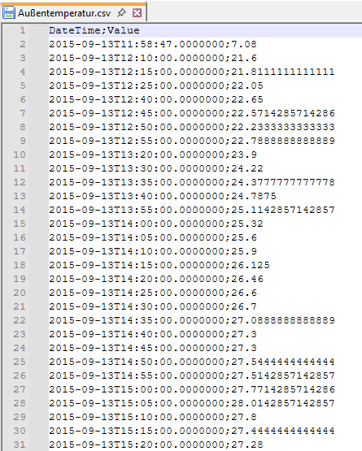

Ich möchte allerdings nicht ausschließlich die Ergebnisse diskutieren, sondern vor allem auch beschreiben wie diese erreicht werden. Um die einleitende Analyse der Ergebnisse bewerkstelligen zu können wurden mehrere Hunderttausend Datenpunkte mit Hilfe der Loxone Statistikfunktion gesammelt. Diese werden nächtlich über einen Scheduled Task und ein selbst gezimmertes .NET/C# Exportprogramm über FTP von meinen beiden Loxone Miniservern gespiegelt.

Für die Weiterverarbeitung in einem BI Analysetool werden die Statistikdaten normalisiert. Dabei werden die Dateien unter Anwendung hochgradiger Parallelisierung ausgelesen und in Zeitreihen umgewandelt, wobei je Messpunkt ein File erzeugt wird. Erwähnenswert ist hierbei, dass Loxone die Daten einzelner Messpunkte mitunter auf mehrere Files verteilt, womit die Daten über ein Union Operator zusammengeführt werden müssen, was sich erheblich auf die Performance des Export auswirkt. Durch eine Performance Optimierung nach allen Regeln der Kunst, lasst sich der Gesamtdatenbestand ohne manuelle Eingriffe nun in wenigen Minuten aufbereiten. Der Export erfolgt zur Geisterstunde um etwaige Probleme mit simultaner Bearbeitung der lokal gespiegelten Files zu vermeiden.

So haben sich über die letzten Jahre um die 140 Datenfiles mit insgesamt knapp 40 Millionen Datenpunkten verschiedenster Art angesammelt und vielfältige Analysemöglichkeiten rund um das Heizaggregat, Mischerregelung, Heizungs- und Warmwasserpuffer, Einzelraumregelung, thermische Solaranlage, PV, Pool, Wetterstation, Stromverbräuche, Stromkosten, usw. geschaffen.

Business Intelligence

Unter Anwendung von Excel ist der Datenflut aus meiner Loxoneautomatisierung kaum Herr zu werden. Hinzu kommt, dass die Informationen mehr oder weniger in Echtzeit bereitstellen sollen, um auch Ereignisse der jüngsten Vergangenheit ohne weitere Aufbereitungsarbeiten analysieren zu können.

Die Lösung dazu liefert Microsoft Power BI.

https://www.microsoft.com/de-de/power-platform/products/power-bi?market=de

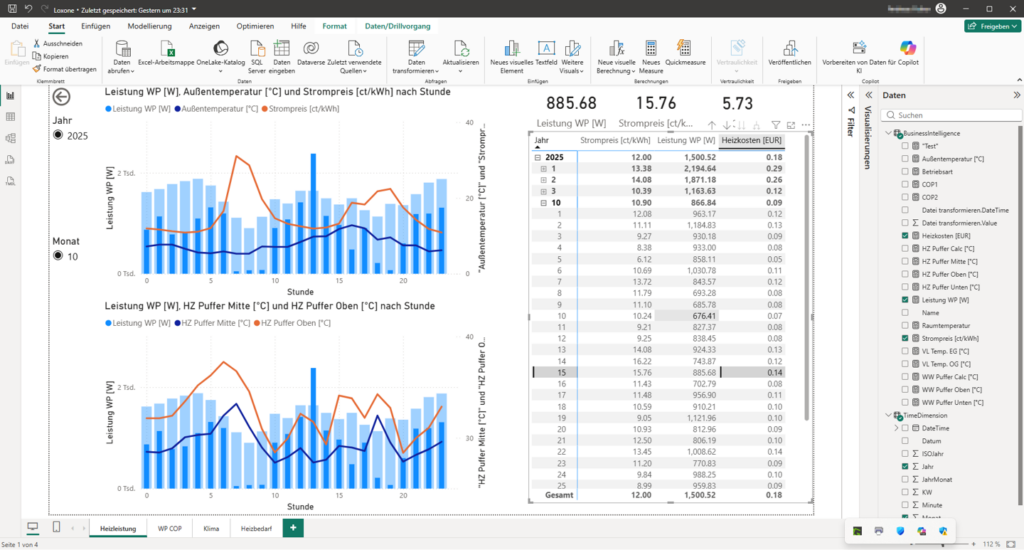

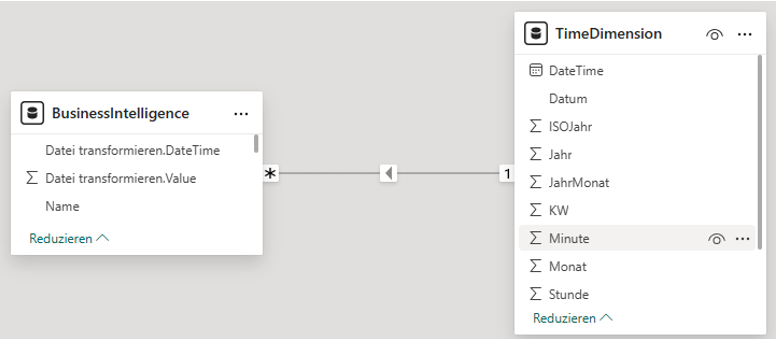

Die normalisierten Daten werden aus den verschiedenen Datenquellen (140 CSV Files) über Power Query performant geladen, Datentypen aufbereitet, Spaltennamen zugewiesen, etc. Zusätzlich erfolgt die Erstellung einer Zeit Dimension um die Datenpunkte über die jeweiligen Timestamps verbinden zu können und später einen Drill-Down vom Jahr bis zur Sekunde bereitstellen zu können.

Die dazu notwendige relationale vom Timestamp der Zeit Dimension 1:n zu den Loxone Datenpunkten muss vorab in der Modellansicht von Power BI erstellt werden.

Um die normalisierten Daten zu Analysezwecken nutzbar zu machen, werden nun noch Measures angelegt, in den festgelegt wird welche vorverarbeiteten Rohdaten aus Power Query anhand von Filter berücksichtigt werden müssen und in denen auch definiert wird wie die Aggregation von einer tieferen auf eine höhere Ebene zu erfolgen hat (z.B. Durchschnittswerte, Median, Summen, …).

Mit einem geeigneten Schul-, Universitäts- oder Geschäftskonto, ließen sich die Daten sogar spielend über Browser oder Mobile App veröffentlichen.

Alles in allem nachvollziehbar, warum Microsoft Power BI in den letzten Jahren das den Business Intelligence Markt dominiert hat und sich auch im industriellen Umfeld immer weiter verbreitet.